my_insights

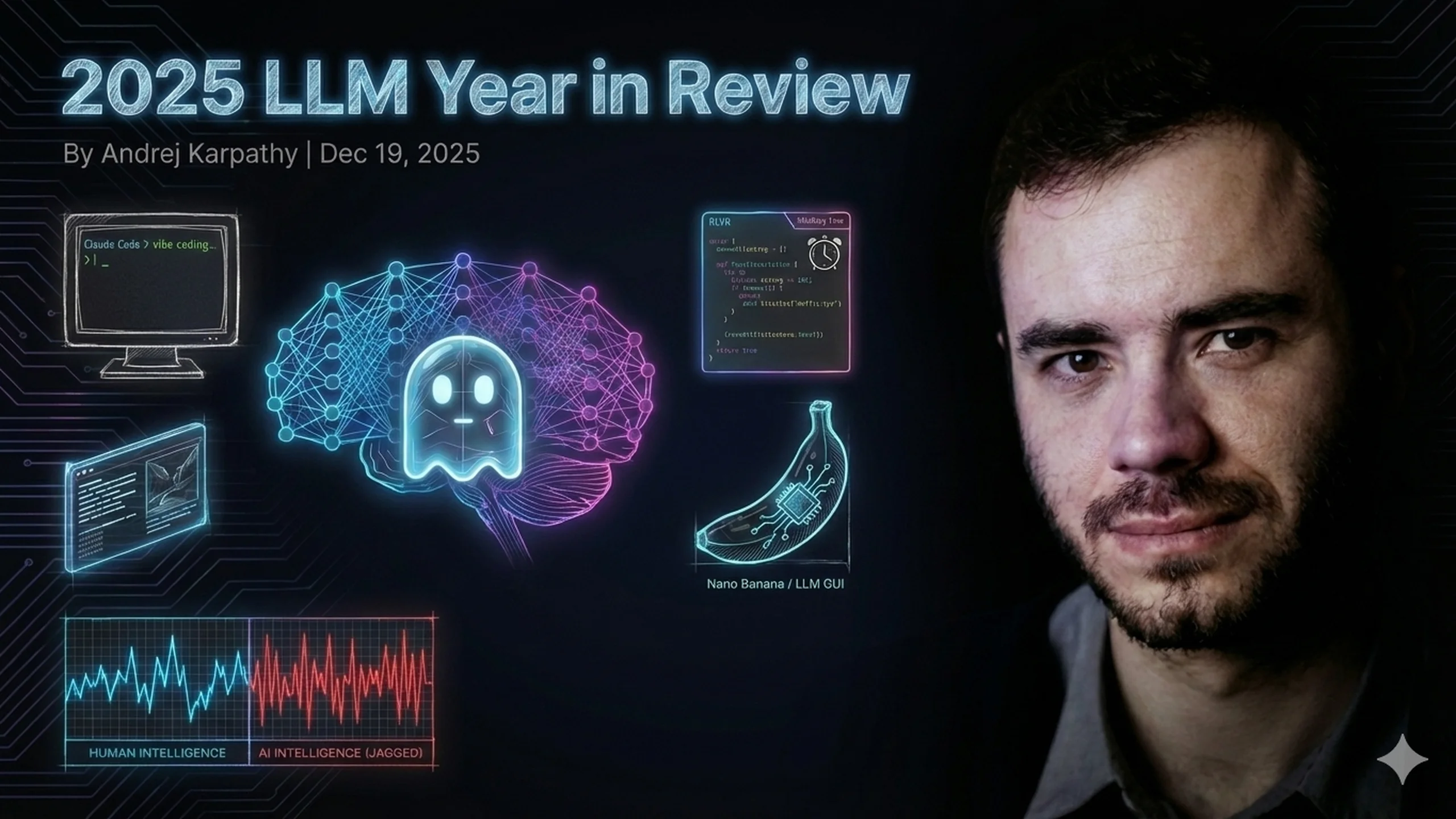

LLM 个人知识库:从信息摄取到知识固化后的闭环操作指南

在 AI 时代,我们面临的挑战不再是找不到信息,而是信息无法转化为持久的资产。传统的检索增强生成(RAG)如同一场“临时面试”,你喂给 LLM 几个片段,它拼凑出一个答案,然后转头就忘。

my_insights

LLM 个人知识库:从信息摄取到知识固化后的闭环操作指南

在 AI 时代,我们面临的挑战不再是找不到信息,而是信息无法转化为持久的资产。传统的检索增强生成(RAG)如同一场“临时面试”,你喂给 LLM 几个片段,它拼凑出一个答案,然后转头就忘。